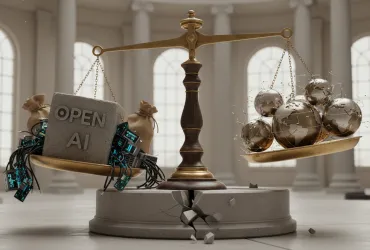

La Commissione Europea, nell'ambito dell'attuazione del Digital Markets Act (DMA), ha recentemente introdotto una proposta normativa che sta sollevando un acceso dibattito tra gli esperti di sicurezza informatica e i difensori della riservatezza dei dati. La norma in questione imporrebbe a Google l'obbligo di trasferire i dati relativi alle ricerche degli utenti a terze parti interessate attraverso un'interfaccia di programmazione delle applicazioni, comunemente nota come API. Sebbene l'intento primario del legislatore europeo sia quello di abbattere le barriere monopolistiche e favorire la libera concorrenza nel mercato digitale, consentendo a motori di ricerca più piccoli di accedere a informazioni preziose, le implicazioni per la sicurezza dei cittadini dell'Unione Europea appaiono, secondo molti, estremamente pericolose.

Esperti di fama internazionale nel campo della protezione dei dati, tra cui spicca la figura di Lukasz Olejnik, hanno analizzato nel dettaglio la bozza del documento, evidenziando come i meccanismi previsti per l'anonimizzazione dei dati prima della loro trasmissione siano affetti da vulnerabilità fondamentali. Secondo Olejnik, il sistema non sarebbe in grado di impedire la re-identificazione degli utenti, trasformando di fatto un'iniziativa di apertura del mercato in un potenziale strumento per la sorveglianza di massa su scala continentale. La preoccupazione principale risiede nella mole e nella natura dei dettagli che verrebbero condivisi: non solo i testi completi delle interrogazioni di ricerca, ma anche i timestamp precisi, le coordinate geografiche approssimative, il tipo di dispositivo utilizzato, la lingua impostata e una serie di segnali comportamentali granulari come i clic effettuati, lo scorrimento delle pagine e le successive rifiniture della ricerca.

Anche se la proposta prevede la rimozione degli indirizzi IP e degli identificativi degli account, i ricercatori sostengono che i dati residui siano più che sufficienti per risalire all'identità reale delle persone. Il cuore del sistema di anonimizzazione proposto si basa su un modello definito di "lista bianca" o allowlist. In pratica, i singoli termini di una ricerca o parole chiave vengono autorizzati al trasferimento solo se sono stati digitati da almeno 50 utenti autorizzati in un arco temporale di 13 mesi. Una volta che un termine entra in questo elenco, vi rimane per un periodo che può estendersi fino a cinque anni. Tuttavia, questo filtro si applica ai frammenti e non all'intera query: ciò significa che ricerche uniche, sensibili o estremamente specifiche, se composte da parole comuni, potrebbero comunque essere incluse nel flusso di dati esportato, esponendo dettagli intimi della vita privata, della salute o degli orientamenti politici degli utenti.

L'architettura descritta da Olejnik aprirebbe inoltre il fianco a manipolazioni mirate da parte di attori malevoli. Attraverso una tecnica nota come "seeding" o inseminazione dei dati, degli aggressori potrebbero utilizzare reti di account automatizzati per generare ripetutamente ricerche contenenti termini specifici, forzandone l'inserimento nella lista bianca della Commissione Europea. Una volta approvati, questi termini permetterebbero di monitorare per anni le attività di ricerca correlate a individui, organizzazioni o temi sensibili in tutta l'Europa. A questo si aggiunge il rischio di incrocio dei dati con fonti esterne. Molte aziende che riceverebbero i dati attraverso l'API di Google gestiscono già propri sistemi di analisi web e script di tracciamento; confrontando i log di navigazione con i dati di ricerca, risulterebbe elementare ricostruire la cronologia completa delle attività online di un singolo utente, rendendo l'anonimizzazione del tutto vana.

Un ulteriore punto critico riguarda la geolocalizzazione. Sebbene le coordinate siano raggruppate in aree di almeno 3 km² con una base minima di 1.000 utenti, tali zone possono coincidere perfettamente con distretti governativi, campus universitari, basi militari o quartieri specifici nelle grandi città come Parigi, Berlino o Roma. Con il passare del tempo, osservatori attenti potrebbero identificare schemi comportamentali legati a luoghi sensibili, come strutture sanitarie specializzate o uffici istituzionali, compromettendo la sicurezza nazionale e la libertà individuale. Lukasz Olejnik definisce questa proposta come una delle più gravi minacce alla protezione dei dati emerse negli ultimi anni in Europa, sottolineando che le garanzie attualmente previste si basano più su controlli procedurali che su solide difese tecniche. In una fase in cui la sovranità digitale è al centro dell'agenda politica, il rischio è che il DMA, nato per proteggere i consumatori dai giganti del Big Tech, finisca per sacrificarne la privacy sull'altare della concorrenza economica, creando un precedente pericoloso per la democrazia europea.