Anthropic ha ufficialmente confermato lo sviluppo e la fase di test, con un accesso anticipato per alcuni clienti, di una nuova IA modello superiore a tutte le precedenti. Questa conferma è arrivata in seguito a una fuga di dati accidentale che ha svelato l'esistenza di Claude Mythos, un nuovo livello denominato Capybara e rischi senza precedenti per la sicurezza informatica, secondo la stessa azienda.

La conferma pubblica è seguita alla diffusione di bozze di documenti, scoperte in una cache di dati accessibile al pubblico e analizzate da Fortune. Fino a giovedì sera, una bozza di un post del blog era disponibile in un archivio non protetto e ricercabile, dove la nuova IA modello era chiamata Claude Mythos e descritta come un'intelligenza artificiale che crea rischi senza precedenti nel campo della sicurezza informatica. Dopo una notifica da Fortune, l'azienda ha chiuso la ricerca pubblica nell'archivio e l'accesso ai documenti. Anthropic ha dichiarato che l'accessibilità dei contenuti della bozza è stata il risultato di un «errore umano» nella configurazione del sistema di gestione dei contenuti.

La portata della fuga di notizie è stimata in quasi 3.000 materiali relativi al blog di Anthropic, precedentemente non pubblicati su piattaforme di notizie o di ricerca dell'azienda, nonché documenti che sembravano essere interni. Questa valutazione è stata fornita da Alexandre Pauwels, ricercatore di sicurezza informatica dell'Università di Cambridge, a cui Fortune ha chiesto di analizzare il set di dati. Indipendentemente da lui, i documenti sono stati scoperti e studiati anche da Roy Paz, ricercatore senior di sicurezza IA presso LayerX Security.

Nella cache era presente anche un file PDF su un prossimo evento privato fuori sede per amministratori delegati di società europee nel Regno Unito con la partecipazione di Dario Amodei, amministratore delegato di Anthropic. L'evento, della durata di 2 giorni, è stato descritto come un «incontro a porte chiuse» e prevedeva discussioni sull'implementazione dell'IA nel mondo degli affari, nonché una dimostrazione delle nuove capacità di Claude.

Negli stessi materiali figurava il nome Capybara. Era usato per riferirsi a un nuovo livello di IA modelli più grandi e più intelligenti di Opus, precedentemente considerati i più potenti nella linea dell'azienda. Secondo il contenuto dei documenti, Capybara e Mythos si riferiscono alla stessa IA modello di base. Anthropic attualmente vende modelli a tre livelli: Opus, Sonnet e Haiku. Capybara è stata descritta come un'IA superiore a Opus in termini di capacità e costi.

La bozza affermava anche che, rispetto a Claude Opus 4.6, la nuova IA modello mostra risultati significativamente più elevati nei test di programmazione, ragionamento accademico e sicurezza informatica. Affermava anche il completamento della formazione di Claude Mythos, definita la più potente IA modello nella storia dell'azienda. La struttura del documento con intestazioni e data di pubblicazione indicava la preparazione di un lancio del prodotto. Lo schema di lancio sul mercato prevedeva un accesso anticipato limitato, poiché l'IA modello è costosa da utilizzare e non è ancora pronta per essere distribuita al pubblico.

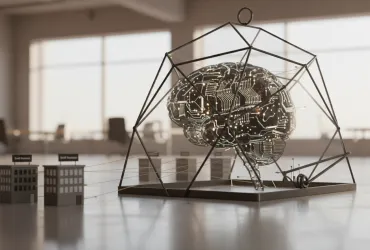

Un tema chiave dei materiali trapelati erano i rischi per la sicurezza informatica. Il modello è stato descritto come un sistema significativamente più avanti rispetto ad altri IA modelli in termini di capacità informatiche e anticipa un'ondata di soluzioni in grado di sfruttare le vulnerabilità più velocemente di quanto la sicurezza informatica possa contrastarle. Pertanto, l'accesso anticipato è stato pianificato per essere fornito alle organizzazioni coinvolte nella difesa informatica per dare loro un vantaggio nell'aumentare la resilienza delle basi di codice agli attacchi gestiti dall'IA.

Questo approccio è coinciso con un più ampio cambiamento del settore. A febbraio, OpenAI, con il rilascio di GPT-5.3-Codex, ha affermato che si trattava della sua prima IA modello classificata nell'ambito del Preparedness Framework come sistema con un alto livello di capacità per attività relative alla sicurezza informatica e il primo modello direttamente addestrato per identificare le vulnerabilità nel software (SW). Allo stesso tempo, Anthropic ha rilasciato Opus 4.6, in grado di identificare vulnerabilità precedentemente sconosciute nelle basi di codice. L'azienda ha riconosciuto la duplice natura di tale capacità: può aiutare sia gli specialisti della protezione che i malintenzionati.

Anthropic ha anche riferito che gruppi di hacker, comprese strutture presumibilmente collegate al governo cinese, hanno tentato di utilizzare Claude in attacchi informatici reali. In uno di questi casi, un gruppo cinese sostenuto dallo stato ha utilizzato Claude Code per infiltrarsi in circa 30 organizzazioni, tra cui società tecnologiche, istituzioni finanziarie e agenzie governative. Nei 10 giorni successivi, l'azienda ha stabilito la portata dell'operazione, ha bloccato gli account coinvolti negli hack e ha informato le organizzazioni colpite. La vicenda sottolinea l'importanza cruciale della sicurezza e della vigilanza nell'implementazione di tecnologie IA avanzate, evidenziando come anche i modelli più sofisticati possano essere bersaglio di abusi e manipolazioni.