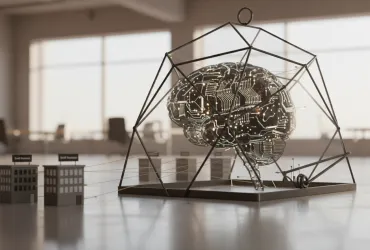

Il panorama della sicurezza informatica globale ha appena varcato una soglia storica e inquietante. Per la prima volta nella storia della tecnologia moderna, gli esperti del Google Threat Intelligence Group (GTIG) hanno identificato e neutralizzato un exploit zero-day generato attraverso l'impiego di sistemi di intelligenza artificiale. Questo evento non rappresenta solo un successo difensivo, ma segna ufficialmente l'inizio di una nuova era per il cybercrime, dove le capacità di automazione e generazione di codice dei modelli linguistici di grande dimensione (LLM) vengono piegate ai fini di attacchi mirati e sofisticati. La scoperta è avvenuta mentre un gruppo di cyber-criminali stava preparando un'offensiva su larga scala contro un'applicazione web open source dedicata all'amministrazione di sistemi, cercando di compromettere i protocolli di autenticazione a due fattori (2FA), considerati fino ad oggi uno dei pilastri della protezione digitale.

Gli analisti di Google sono riusciti a risalire alla natura sintetica del codice analizzando uno script scritto in linguaggio Python. All'interno del codice sono state trovate tracce inequivocabili di un'origine non umana: un punteggio inventato basato sulla scala CVSS (Common Vulnerability Scoring System) e una formattazione eccessivamente accademica, tipica dei dati di addestramento utilizzati per istruire le intelligenze artificiali. In particolare, il punteggio CVSS generato dal modello non corrispondeva a nessuna vulnerabilità reale registrata nei database ufficiali, ma sembrava essere una sorta di allucinazione dell'IA, che ha tentato di autovalutare la pericolosità della sua creazione per renderla più credibile agli occhi degli operatori umani. La struttura stessa del codice riproduceva schemi ricorrenti nei modelli LLM, che tendono a generare soluzioni sintatticamente perfette ma che presentano firme logiche distinte rispetto a quelle di uno sviluppatore umano esperto.

La radice della vulnerabilità non risiedeva in un banale errore di battitura o in un crash del sistema, bensì in un sofisticato errore logico all'interno dell'applicazione web. Lo sviluppatore della piattaforma originale aveva programmato il codice basandosi su un'assunzione di fiducia errata, ritenendo che un determinato componente del sistema fosse intrinsecamente sicuro e saltando quindi i necessari controlli di validazione. È stato proprio attraverso questo componente non verificato che l'intelligenza artificiale ha trovato un varco per bypassare l'autenticazione a due fattori. Sebbene Google non abbia rivelato il nome specifico dell'applicazione target per motivi di sicurezza, è stato confermato che l'attacco è stato sventato in una fase precoce, impedendo che l'exploit venisse utilizzato per colpire migliaia di server in tutto il mondo. Un dato rassicurante è che, secondo le indagini, il modello Gemini di Google non è stato utilizzato per generare questa minaccia, suggerendo l'uso di altre piattaforme o modelli personalizzati dai criminali.

Oltre alla creazione di exploit, il GTIG ha segnalato un'altra tendenza preoccupante: i malintenzionati stanno iniziando ad attaccare direttamente le infrastrutture che ospitano le IA. Questo include colpire le funzioni autonome degli agenti artificiali e i moduli esterni che gestiscono l'accesso ai dati sensibili. Una delle tecniche emergenti più efficaci è quella dell'inganno di ruolo o role-play: gli hacker formulano prompt complessi in cui chiedono all'IA di agire come un esperto di cybersicurezza per aggirare i blocchi etici e le restrizioni di sicurezza integrate. Inoltre, è stato documentato l'uso di strumenti avanzati come OpenClaw, che permette ai criminali di eseguire il debug di malware in ambienti controllati, perfezionando il codice prima del dispiegamento reale. L'integrazione di interi database di vulnerabilità all'interno dei modelli permette oggi agli hacker di mappare le debolezze di una rete con una velocità e una precisione che nessun team umano potrebbe eguagliare, rendendo necessario un aggiornamento radicale delle strategie di difesa globale.

In conclusione, l'episodio rilevato da Google conferma che la competizione tecnologica tra guardie e ladri si è spostata sul piano dell'automazione cognitiva. Se da un lato l'IA offre strumenti senza precedenti per rilevare le minacce in tempo reale, dall'altro abbassa drasticamente la barriera d'ingresso per la creazione di codice malevolo di alta qualità. Le aziende e le organizzazioni governative di tutto il mondo, specialmente in Europa e negli Stati Uniti, dovranno ora affrontare la sfida di proteggere non solo i perimetri software tradizionali, ma anche la logica stessa dei processi automatizzati, garantendo che ogni componente, anche se apparentemente fidato, sia sottoposto a continui test di integrità. La neutralizzazione di questo primo exploit zero-day generato dall'IA è una vittoria significativa, ma rappresenta solo il primo capitolo di una lunga battaglia per la sovranità e la sicurezza digitale nell'era delle macchine pensanti.