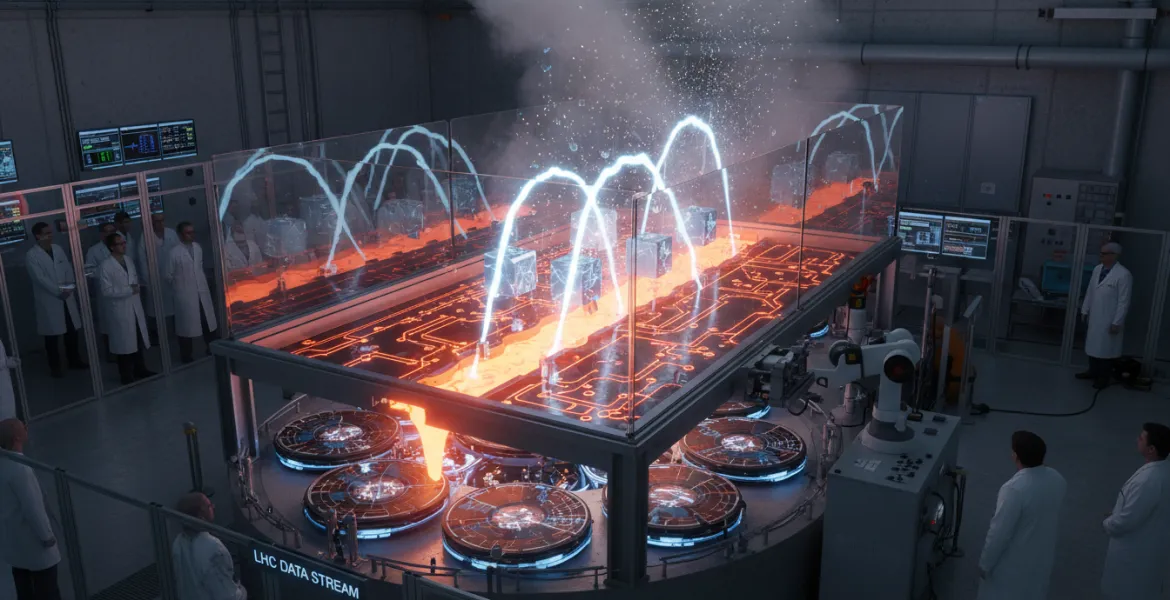

Il Large Hadron Collider (LHC) del CERN genera una quantità impressionante di dati che richiede un'infrastruttura di Intelligenza Artificiale (IA) sofisticata e personalizzata. Contrariamente alle soluzioni convenzionali basate su TPU o GPU, il CERN adotta un approccio unico: integrare modelli di IA direttamente nel silicio per filtrare enormi quantità di dati in tempo reale.

Ogni anno, l'LHC produce circa 40 exabyte di dati grezzi dai suoi sensori, una cifra che corrisponde a circa un quarto dell'intero volume di internet. Conservare una tale quantità di informazioni è impraticabile, quindi il CERN deve selezionare in tempo reale i dati di maggior valore. Questo processo comporta la gestione di flussi di dati fino a centinaia di terabyte al secondo, richiedendo algoritmi di elaborazione estremamente veloci, motivo per cui vengono integrati direttamente nei chip.

All'interno dell'anello di 27 km dell'LHC, le particelle subatomiche si scontrano a velocità prossime a quella della luce. Circa 2.800 fasci di protoni si muovono costantemente lungo l'anello, intervallati da 25 nanosecondi. Nonostante l'accelerazione controllata, le collisioni rimangono eventi rari: solo circa 60 coppie di protoni si scontrano in ogni sessione su miliardi di particelle. Queste collisioni generano nuove particelle, che vengono rilevate dai sofisticati rivelatori del CERN.

Ogni collisione tra coppie di particelle genera diversi megabyte di dati. Con circa un miliardo di collisioni al secondo, si arriva approssimativamente a 1 petabyte di informazioni. Raccogliere e archiviare tali volumi di dati grezzi è tecnicamente impossibile. Perciò, il CERN ha sviluppato un sistema di calcolo avanzato per distinguere i dati "interessanti" da quelli "irrilevanti" direttamente a livello dei rivelatori.

I rivelatori utilizzano ASIC (Application-Specific Integrated Circuits) per bufferizzare i dati per non più di 4 microsecondi. I dati vengono salvati o eliminati definitivamente. La decisione è presa da un filtro chiamato Level One Trigger, basato su circa 1.000 FPGA (Field-Programmable Gate Arrays) che ricevono dati tramite linee ottiche a una velocità di circa 10 terabyte al secondo. Le decisioni vengono prese in tempo reale dai chip stessi, poiché la memoria esterna più veloce non potrebbe gestire un flusso di informazioni così intenso. Un algoritmo speciale, AXOL1TL, prende decisioni in meno di 50 nanosecondi. Di fatto, solo lo 0,02% circa delle informazioni sulle collisioni viene conservato, pari a circa 110.000 eventi al secondo. I dati selezionati vengono inviati in superficie, ma anche dopo questa prima fase di filtraggio, si tratta comunque di terabyte di dati al secondo.

In superficie, un secondo filtro, l'High Level Trigger, seleziona circa 1.000 eventi al secondo per l'analisi. Questo sistema è dotato di 25.600 CPU e 400 GPU che ricostruiscono le collisioni e selezionano gli eventi più interessanti per l'analisi dei risultati. Il risultato finale è circa 1 petabyte al giorno di nuovi dati, distribuiti tra 170 centri scientifici in 42 paesi, dove vengono analizzati da scienziati di tutto il mondo. La potenza di calcolo complessiva di tutti i partecipanti al progetto è di circa 1,4 milioni di core. Il CERN mira a misurare i parametri delle collisioni con una precisione del 99,999%, uno "standard aureo" necessario per annunciare scoperte scientifiche significative.

Gli strumenti di IA tradizionali non sono adatti per i rivelatori dell'LHC, quindi gli ingegneri del CERN hanno dovuto sviluppare un proprio stack. I modelli di IA per l'LHC sono specificamente ridotti, modernizzati, parallelizzati e ottimizzati per identificare solo i dati veramente importanti. Nel caso dell'LHC, questi modelli sono altrettanto performanti ma significativamente "più economici" rispetto ai modelli di Machine Learning (ML) convenzionali. Per trasferire i modelli in un ambiente hardware, viene utilizzato il compilatore HLS4ML, che converte il modello in codice C++ eseguibile su acceleratori di IA, SoC (System on a Chip), FPGA personalizzati e persino integrato negli ASIC. Una parte significativa delle risorse del chip è dedicata non all'algoritmo stesso, ma a tabelle con risultati precalcolati per valori di input tipici, accelerando ulteriormente il filtraggio delle informazioni.

Alla fine dell'anno, l'LHC sarà chiuso per manutenzione e aggiornamenti. Il nuovo e più potente acceleratore, l'High Luminosity LHC, dovrebbe entrare in funzione nel 2031. Sarà dotato di magneti più potenti per focalizzare i fasci di particelle, i fasci stessi raddoppieranno le dimensioni, il collisore genererà 10 volte più dati e il volume di informazioni per ogni evento aumenterà da 2 a 8 megabyte. Il CERN ha già accumulato 1 exabyte di dati dall'LHC, ma questa è solo una frazione di ciò che dovrà essere archiviato ed elaborato nei prossimi 10 anni. Mentre i principali laboratori di IA creano LLM (Large Language Model) di dimensioni sempre maggiori, il CERN si muove nella direzione opposta, semplificando e accelerando l'identificazione di eventi insoliti tramite l'intelligenza artificiale.