Una crescente ondata di preoccupazione sta scuotendo le fondamenta di colossi tecnologici come Google e OpenAI, con centinaia di dipendenti che si ribellano all'idea di vedere le proprie creazioni impiegate in contesti bellici. La scintilla è scoccata in seguito all'inserimento di Anthropic, un'altra azienda del settore AI, nella blacklist del Dipartimento della Difesa statunitense (Pentagono), una mossa che ha sollevato interrogativi inquietanti sull'etica e la responsabilità nell'uso dell'intelligenza artificiale.

La protesta si è concretizzata in una lettera aperta intitolata "Non saremo divisi", sottoscritta da quasi 900 persone, tra cui circa cento dipendenti di OpenAI e ottocento di Google. Il documento critica aspramente le pressioni esercitate dal Pentagono su Anthropic, rea di aver rifiutato di piegare la propria tecnologia a scopi di sorveglianza di massa o per lo sviluppo di armi completamente autonome. "Stanno cercando di dividere ogni azienda, sperando che l'altra ceda", si legge nella lettera, "Questa strategia funziona solo se nessuno di noi conosce la posizione dell'altro. Questa lettera ha lo scopo di creare comprensione e solidarietà di fronte a questa pressione da parte del Dipartimento della Difesa."

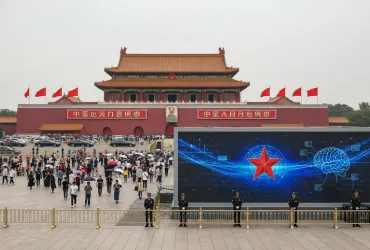

La tensione nel settore tecnologico è palpabile da mesi, con crescenti richieste di trasparenza sulle collaborazioni tra aziende e governi, soprattutto per quanto riguarda i contratti relativi a tecnologie cloud e intelligenza artificiale. Nel caso di Google, le critiche si sono intensificate a seguito delle indiscrezioni su una presunta trattativa con il Pentagono per integrare il modello AI Gemini in un sistema militare top-secret. Il gruppo No Tech For Apartheid, da tempo impegnato a denunciare gli accordi tra giganti tecnologici e il governo statunitense, ha pubblicato una dichiarazione congiunta dal titolo "Amazon, Google, Microsoft devono respingere le richieste del Pentagono", esortando le aziende a rifiutare condizioni che potrebbero consentire sorveglianza di massa o altri usi impropri dell'AI.

Il dito è puntato soprattutto contro Google, in riferimento alla potenziale intesa con il Pentagono, simile all'accordo che permetterebbe al Dipartimento della Difesa di utilizzare Grok di xAI "in ambienti segreti, a quanto ne sappiamo, senza alcuna restrizione". Mentre Anthropic e OpenAI hanno rilasciato dichiarazioni pubbliche riguardo alle loro negoziazioni con il Dipartimento della Difesa, Alphabet, la casa madre di Google, mantiene il silenzio.

La lettera aperta in sostegno di Anthropic chiede al Dipartimento della Difesa di revocare la designazione dell'azienda come "rischio per la catena di approvvigionamento" e invita il Congresso a "esaminare la questione dell'opportunità di utilizzare questi poteri straordinari contro una società tecnologica americana". Timori analoghi sono stati espressi internamente a Google, dove oltre 100 dipendenti che lavorano sulle tecnologie di intelligenza artificiale hanno manifestato preoccupazione per la collaborazione dell'azienda con il Dipartimento della Difesa, chiedendo che vengano stabilite le stesse "linee rosse" tracciate da Anthropic. Il capo scienziato di Google, Jeff Dean, ha espresso il timore che "la sorveglianza di massa violi il Quarto Emendamento e abbia un effetto dissuasivo sulla libertà di espressione", e che i sistemi di sorveglianza "siano soggetti ad abusi per scopi politici o discriminatori".

Non tutti i manager di Google sembrano condividere questa posizione. Nel 2018, l'azienda ha affrontato una rivolta interna da parte di migliaia di dipendenti a causa del Project Maven, un programma del Pentagono che utilizzava l'AI per analizzare video di droni. In seguito, l'azienda ha elaborato i suoi "Principi di AI", che definiscono le modalità di utilizzo di queste tecnologie. Tuttavia, le preoccupazioni persistono. Nel 2024, Google ha licenziato oltre 50 dipendenti a seguito di proteste contro il Project Nimbus, un contratto congiunto con Amazon da 1,2 miliardi di dollari per la collaborazione con il governo israeliano. Sebbene i dirigenti abbiano affermato che il contratto non violava nessuno dei "Principi di AI", documenti e rapporti indicano che l'accordo consentiva di fornire a Israele strumenti di AI, tra cui la categorizzazione di immagini, il tracciamento di oggetti e posizioni per i produttori di armi statali. All'inizio dello scorso anno, Google avrebbe rivisto i suoi principi in materia di intelligenza artificiale, eliminando le formulazioni che vietavano esplicitamente la "creazione di armi" o "tecnologie di sorveglianza", un segnale che, per molti, indica un'inversione di rotta potenzialmente pericolosa.