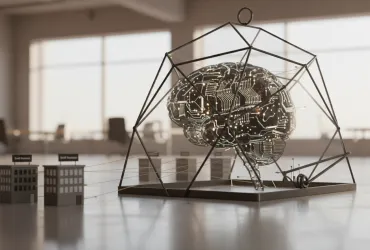

L'orizzonte della cybersecurity si fa sempre più cupo: Anthropic, OpenAI e altre aziende leader nel settore tecnologico stanno sviluppando modelli di Intelligenza Artificiale (IA) capaci di intensificare in modo esponenziale la minaccia di cyberattacchi su vasta scala contro sistemi aziendali, governativi e municipali. Al centro dell'attenzione c'è Claude Mythos, un modello di IA ancora in fase di sviluppo da parte di Anthropic. Secondo quanto riportato da Axios, l'azienda stessa ha avvertito funzionari statunitensi di alto livello che l'introduzione di Claude Mythos, prevista per il 2026, aumenterà notevolmente la probabilità di attacchi di tale portata, rendendo il panorama della sicurezza informatica ancora più precario.

Mythos è descritta come un sistema che consentirebbe agli agenti di IA di infiltrarsi autonomamente, con elevata precisione e complessità, nei sistemi di aziende, governi e comuni. Jim VandeHei, amministratore delegato di Axios, ha rivelato nella sua newsletter per dirigenti che una fonte a conoscenza dei futuri modelli di IA prevede un grave cyberattacco già nel 2026, con le aziende identificate come obiettivi particolarmente vulnerabili.

Un'analisi di Fortune, basata su materiali trapelati dal blog di Anthropic riguardanti Claude Mythos, dipinge un quadro ancora più allarmante. L'IA viene descritta come un sistema che «attualmente supera di gran lunga qualsiasi altro modello di IA in termini di capacità informatiche». Il rapporto sottolinea inoltre che Mythos «preannuncia un'ondata imminente di modelli di IA in grado di sfruttare le vulnerabilità in modo tale da superare di gran lunga gli sforzi di difesa informatica». A incrementare il rischio è anche l'uso non consapevole da parte dei dipendenti di agenti di IA, che potrebbe inavvertitamente semplificare l'accesso dei criminali informatici ai sistemi interni delle loro aziende.

Già alla fine del 2025, Anthropic ha reso noto il primo caso documentato di cyberattacco eseguito in larga misura da un'IA. Un gruppo cinese, supportato dal governo, ha utilizzato agenti di IA per violare autonomamente circa 30 obiettivi in tutto il mondo. L'IA ha gestito autonomamente dall'80% al 90% delle operazioni tattiche. Questo è avvenuto prima del forte potenziamento dei sistemi di agenti e prima della comparsa di nuovi e pericolosi modi di utilizzarli. Oggi, secondo i dati più recenti, si stima che i cyberattacchi andati a buon fine siano aumentati del 15% rispetto all'anno precedente.

I nuovi modelli di IA si distinguono per la loro maggiore capacità di supportare il funzionamento autonomo degli agenti di IA. Si tratta di sistemi che consentono agli agenti di pensare, agire, ragionare e improvvisare in modo indipendente, senza interruzioni o affaticamento. La portata di un attacco è ora determinata principalmente dalle risorse di calcolo degli aggressori, piuttosto che dalle dimensioni del loro gruppo. Questo significa che un singolo individuo potrebbe essere in grado di condurre cyberattacchi che in precedenza avrebbero richiesto team interi.

Parallelamente, cresce anche la vulnerabilità delle aziende. I dipendenti utilizzano sempre più spesso modelli come Claude, Copilot e altri agenti, spesso da casa, e creano i propri agenti di IA. In molti casi, questi agenti accedono ai sistemi di lavoro interni senza un controllo adeguato, creando un'ulteriore via d'accesso per i criminali informatici. Nel settore, questo uso non autorizzato o non controllato dell'IA è noto come «IA ombra».

Un sondaggio condotto da Dark Reading ha rivelato che il 48% degli esperti di sicurezza informatica considera l'agente IA il principale vettore di attacco nel 2026. Questa minaccia è considerata superiore ai deepfake e a tutti gli altri rischi inclusi nel sondaggio. È fondamentale che ogni dipendente di qualsiasi azienda al mondo comprenda il rischio di utilizzare agenti di IA in prossimità di informazioni sensibili. Il team tecnico di Axios ritiene che questa sia la più grande minaccia per l'azienda al momento. La conclusione pratica è chiara: è necessario un ambiente sicuro e isolato per lavorare con gli agenti di IA, implementando misure di sicurezza avanzate e protocolli di controllo rigorosi per proteggere i dati aziendali da potenziali violazioni.