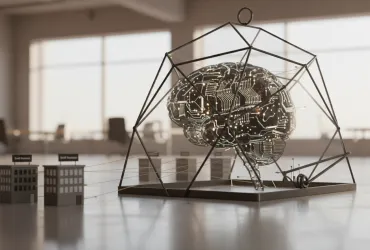

Un recente rapporto di SecurityScorecard ha rivelato una preoccupante vulnerabilità nella piattaforma di intelligenza artificiale (AI) basata su agenti OpenClaw. Secondo il rapporto, decine di migliaia di sistemi che utilizzano OpenClaw sono a rischio di essere compromessi a causa di implementazioni automatizzate e controlli di accesso configurati in modo errato. Questa scoperta solleva serie preoccupazioni sulla sicurezza delle piattaforme AI e sulla loro crescente popolarità.

OpenClaw, precedentemente noto come Clawdbot e Moltbot, è una piattaforma AI progettata per operare e agire continuamente per conto degli utenti. Il software consente agli agenti AI di eseguire comandi, interagire con servizi esterni, integrarsi con piattaforme di messaggistica e operare con ampi privilegi di accesso al sistema. La piattaforma sta guadagnando popolarità tra sviluppatori, aziende e singoli utenti che sperimentano assistenti autonomi in grado di svolgere compiti nel mondo reale.

Tuttavia, la crescente popolarità di OpenClaw è accompagnata da segnalazioni di gravi vulnerabilità del sistema. I ricercatori hanno identificato 28.663 indirizzi IP univoci in 76 paesi che ospitano pannelli di controllo OpenClaw accessibili. Di questi, 12.812 istanze sono risultate vulnerabili all'esecuzione di codice da remoto e il 63% delle implementazioni osservate sono state classificate come sfruttabili. Secondo i ricercatori, 549 istanze vulnerabili sembrano essere già state compromesse.

Il rapporto evidenzia che molte implementazioni di OpenClaw sono vulnerabili a causa di impostazioni predefinite non sicure. Inizialmente, OpenClaw collega il suo pannello di controllo a tutte le interfacce di rete, rendendolo accessibile da Internet. Un numero significativo di istanze vulnerabili operava su versioni obsolete del software, nonostante fossero disponibili patch per diverse gravi vulnerabilità. Solo un piccolo numero di sistemi utilizzava l'ultima versione di OpenClaw.

Per molte delle vulnerabilità scoperte sono disponibili exploit pubblicamente accessibili, con valutazioni di gravità della minaccia che variano da 7,8 a 8,8 su una scala di dieci punti. Lo sfruttamento di queste vulnerabilità potrebbe consentire agli aggressori di ottenere il controllo completo sul sistema host ed ereditare tutto ciò a cui ha accesso l'agente AI, come chiavi API, token OAuth, credenziali SSH, sessioni del browser e account di messaggistica connessi.

A complicare ulteriormente la situazione, gli agenti OpenClaw sono progettati per operare con autorità legittime, il che significa che l'attività dannosa può apparire normale, ritardando il rilevamento e aumentando il potenziale danno. È stato scoperto che le istanze di OpenClaw sono fortemente concentrate presso i principali provider di cloud e hosting, il che indica il riutilizzo su larga scala di schemi di implementazione non sicuri. Durante il periodo di studio, il numero di istanze accessibili da Internet identificate ha continuato a crescere, superando alla fine le 40.000.

I ricercatori hanno sottolineato che la vulnerabilità di OpenClaw è solo un indicatore di un problema di sicurezza globale più ampio che i sistemi AI basati su agenti devono affrontare. SecurityScorecard avverte che, man mano che i sistemi AI autonomi diventano più diffusi, le tradizionali debolezze della sicurezza, come le interfacce di gestione aperte, l'autenticazione debole e le impostazioni predefinite non sicure, sono esacerbate dall'automazione. Ciò crea facili bersagli per gli aggressori e mette in discussione la giustificazione per l'aumento della produttività attraverso tali mezzi.

Le vulnerabilità scoperte in OpenClaw evidenziano la necessità di un approccio più rigoroso alla sicurezza delle piattaforme AI. Gli sviluppatori e gli utenti devono essere consapevoli dei rischi potenziali e adottare misure adeguate per proteggere i propri sistemi. Ciò include l'implementazione di controlli di accesso robusti, il mantenimento del software aggiornato e la revisione regolare delle configurazioni di sicurezza.

Inoltre, è fondamentale che i provider di cloud e hosting adottino misure proattive per identificare e mitigare le vulnerabilità nelle piattaforme AI che ospitano. Ciò potrebbe includere l'esecuzione di scansioni di sicurezza regolari, la fornitura di indicazioni agli utenti sulle migliori pratiche di sicurezza e la collaborazione con i fornitori di software per affrontare le vulnerabilità non appena vengono scoperte.

Mentre l'AI continua a svolgere un ruolo sempre più importante nelle nostre vite, è essenziale garantire che questi sistemi siano sicuri e affidabili. Le vulnerabilità scoperte in OpenClaw sono un campanello d'allarme che ci ricorda che la sicurezza dell'AI deve essere una priorità assoluta.