Recentemente, OpenAI ha sorpreso gli utenti con l'introduzione del nuovo modello di intelligenza artificiale GPT-5, promettendo di migliorare significativamente l'interazione con il loro chatbot. Sperando di semplificare l'esperienza, OpenAI aveva introdotto un sistema di selezione automatica, che determinava il miglior approccio tra risposte rapide e riflessive. Tuttavia, molti utenti si sono mostrati insoddisfatti, portando l'azienda a ripristinare la scelta manuale delle **versioni IA, comprese le predilette danni passati.

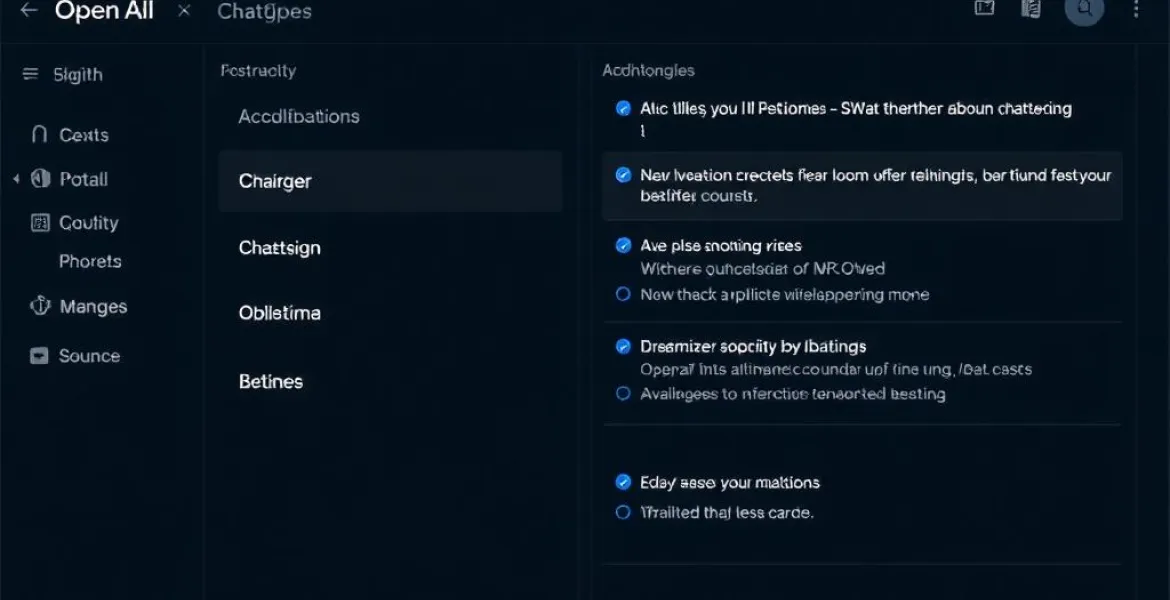

Nel menù ora comparso, gli utenti possono scegliere tra tre modalità di GPT-5 disponibili: Auto, Fast, e Thinking. La modalità Auto lascia spazio alla selezione automatica, mentre Fast offre risposte immediate e Thinking privilegia l'elaborazione ponderata. Per i clienti a pagamento, OpenAI ha reintrodotto l'opzione di utilizzare modelli precedentemente classificati come obsoleti, tra cui GPT-4o, GPT-4.1 e o3. Questi modelli devono essere configurati manualmente, ad eccezione del GPT-4o, che è accessibile direttamente dal menu di scelta delle versioni.

Nel suo annuncio, il **CEO di OpenAI, Sam Altman, ha delineato l'evoluzione della configurazione delle IA, puntando verso un'esperienza sempre più personalizzata: "Stiamo lavorando per rendere il carattere di GPT-5 più accogliente, senza quel tratto invadente che caratterizzava GPT-4o. Abbiamo imparato, però, che la personalizzazione è chiave per soddisfare le variegate esigenze degli utenti".

L'implementazione dei nuovi sistema non è stata esente da problemi. Le aspettative nei confronti di GPT-5 erano elevate, dopo il successo delle versioni precedenti, ma il suo lancio ha richiesto più sforzi del previsto. L'opzione di disabilitare il tanto apprezzato GPT-4o e altri modelli consolidati ha provocato il malcontento tra gli utenti, che avevano stabilito un rapporto di fiducia con gli stili di risposta unici di quei modelli.

Il selettore automatico, introdotto con lo scopo di intuire le intenzioni degli utenti in un lasso di tempo estremamente ridotto, non ha sempre funzionato efficacemente. Conseguentemente, alcuni utenti si sono convinti che la performance di GPT-5 fosse inferiore rispetto ai suoi predecessori. L'abilità di intuire l'animo umano rimane una sfida importante per le IA di oggi, dato che ogni singola interazione può richiedere un diverso bilanciamento tra velocità e profondità nelle risposte.

Un altro aspetto degno di nota è l'altro impatto emotivo che l'intelligenza artificiale può esercitare sugli utenti. Un fenomeno recentemente documentato si è verificato a San Francisco, dove centinaia di residenti hanno organizzato una sorta di "funerale" per Claude 3.5 Sonnet, un modello IA di Anthropic, dopo il suo dismissione. Ciò evidenzia come alcune persone sviluppino un attaccamento emotivo significativo nei confronti delle intelligenze artificiali, un'area di studio che sta emergendo nel campo psicologico ed etico delle tecnologie contemporanee.