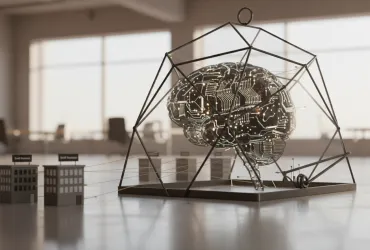

La Cina ha annunciato una bozza di nuove normative volte a regolamentare i servizi di Intelligenza Artificiale (IA) nel paese. L'annuncio, diffuso dalla Cyberspace Administration of China (CAC), segna un passo significativo nel tentativo di Pechino di controllare lo sviluppo e l'implementazione di tecnologie IA, in particolare quelle che interagiscono con gli utenti simulando comportamenti umani.

Le regole proposte si applicheranno a prodotti e servizi che utilizzano l'IA per emulare tratti della personalità umana, modelli di pensiero e stili di comunicazione. Questo include sistemi che forniscono interazioni emotive con gli utenti attraverso testo, immagini, audio o video. L'obiettivo, secondo la CAC, è di trovare un equilibrio tra il supporto all'innovazione e la protezione da potenziali abusi, adottando un approccio di regolamentazione basato sul rischio.

Il progetto di legge proibisce esplicitamente la creazione e la diffusione di contenuti che possano minacciare la sicurezza nazionale, danneggiare l'onore o gli interessi del paese, minare l'unità etnica o promuovere attività religiose illegali. Allo stesso modo, è vietata la diffusione di contenuti che disturbino l'ordine economico o sociale, diffondano voci infondate, o includano materiale pornografico, giochi d'azzardo, violenza o incitamento a comportamenti criminali.

Un aspetto particolarmente rilevante è il divieto di contenuti che incoraggiano o romanticizzano il suicidio o l'autolesionismo, così come azioni che includono abusi verbali o manipolazioni emotive capaci di danneggiare la salute fisica o mentale degli utenti, o che ne minino la dignità. Questa attenzione alla salute mentale sottolinea una crescente preoccupazione per l'impatto psicologico delle interazioni con le IA, soprattutto tra i giovani.

I fornitori di servizi IA saranno tenuti a garantire la sicurezza dei loro prodotti durante l'intero ciclo di vita, implementando sistemi per la verifica degli algoritmi, la protezione dei dati e la salvaguardia delle informazioni personali. Sarà inoltre obbligatorio informare gli utenti quando interagiscono con un'IA e metterli in guardia sui rischi di un utilizzo eccessivo.

Le aziende dovranno anche valutare le emozioni e il livello di dipendenza degli utenti dai loro servizi. Qualora venissero rilevate emozioni forti o comportamenti di dipendenza, i fornitori dovranno adottare le misure necessarie per proteggere l'utente. Questo potrebbe includere l'offerta di supporto psicologico o la limitazione dell'accesso al servizio.

Lin Wei, presidente della Southwest University of Political Science and Law, ha evidenziato come i progressi nell'IA stiano spostando l'interazione uomo-macchina da una semplice assistenza funzionale verso un'interazione emotiva e personalizzata. Questa evoluzione, pur aprendo nuove opportunità, genera anche rischi e sfide inedite. La regolamentazione mira a gestire i rischi derivanti dall'antropomorfismo e dall'interazione emotiva, con particolare attenzione alla potenziale confusione tra uomo e macchina.

Le nuove misure proposte dalla Cina rappresentano un tentativo ambizioso di governare un settore in rapida evoluzione. Resta da vedere come queste regole verranno implementate e quale sarà il loro impatto sull'innovazione e sulla competitività delle aziende cinesi nel campo dell'IA. Tuttavia, è chiaro che Pechino intende giocare un ruolo attivo nella definizione degli standard globali per l'uso responsabile e sicuro dell'Intelligenza Artificiale. La bozza è ora aperta alla discussione pubblica, e si prevede che la versione definitiva sarà pubblicata nei prossimi mesi. L'iniziativa cinese potrebbe influenzare le politiche di altri paesi, aprendo un dibattito internazionale sulla necessità di regolamentare un settore che ha il potenziale di trasformare radicalmente la società.