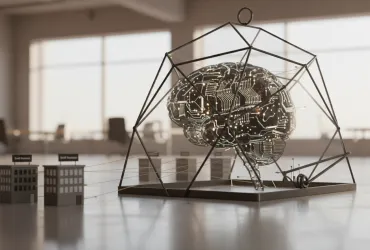

Arm

, leader mondiale nel design di semiconduttori, ha recentemente svelato un'anteprima entusiasmante delle sue nuove GPU mobili, destinate al debutto nel 2026. Questi innovativi processori grafici sono progettati per integrare tecnologie neurali all'avanguardia, promettendo così una qualità visiva superiore e prestazioni senza precedenti. Per agevolare gli sviluppatori,

Arm

ha anche introdotto un'interfaccia di programmazione delle applicazioni (API) che consente di iniziare subito a lavorare con questa nuova infrastruttura, senza attendere il lancio effettivo dell'hardware.

Un aspetto fondamentale di questa avanzata tecnologia è l'utilizzo dell'accelerazione neurale per potenziare la scala grafica a risoluzioni superiori senza comprometterne la fluidità. Tra le applicazioni previste figura anche il raddoppio della frequenza dei fotogrammi mediante l'interpolazione, oltre a miglioramenti nella qualità delle immagini tramite il ray tracing in tempo reale, ottimizzato per dispositivi mobili con una riduzione del numero di raggi per pixel. Il connubio sintetico tra intelligenza artificiale (IA) e grafica in tempo reale è cruciale.

Geraint North

, uno dei ricercatori principali di

Arm

nel settore dell'IA, sottolinea l'importanza di un'IA integrata e performante, soprattutto in termini di efficienza energetica. Egli afferma: "Semplificare lo sviluppo dell'IA su processori grafici per sviluppatori è stato il motore dell'innovazione tecnologica che stiamo presentando oggi."

Nonostante l'entusiasmo suscitato,

Arm

è stata parca nei dettagli tecnici riguardanti questi acceleratori neurali, rinviando le specifiche alla prossima generazione di GPU

Mali

. Ciò che è emerso, tuttavia, è che gli acceleratori saranno integrati nei core shader e che la potenza delle reti neurali verrà scalata in base al numero di core impiegati. La nuova architettura di quinta generazione di Arm supporterà configurazioni fino a 16 core.

L'anno scorso,

Arm

ha introdotto l'

Arm Accuracy Super Resolution

(ASR), una tecnologia di scaling che consente ai giochi di renderizzare immagini a bassa risoluzione per poi applicare algoritmi di scalabilità, riducendo così i costi di elaborazione del frame mentre si mantiene intatta la qualità. In seguito, ha progettato la

Neural Super Sampling

(NSS), un'alternativa basata su hardware neural accelerato, capace di trasformare contenuti da 540p a 1080p in soli 4 ms per frame, riducendo del 50% il carico sul processore grafico.

L'accelerazione tramite

IA

non si ferma qui: la

Neural Frame Rate Upscaling

(NFRU) migliora la fluidità video creando frame intermedi tra sequenze consecutive. "La rete neurale si integra strettamente con l'hardware appena aggiunto per potenziare la generazione dei vettori di movimento, che monitorano il movimento pixel tra i fotogrammi, permettendo così di scalare facilmente i contenuti a 30 FPS a 60 FPS", spiega

North

.

Un'altra innovazione, la

Neural Super Sampling and Denoising

(NSSD), è dedicata al miglioramento della qualità delle immagini del ray tracing. "La combinazione di ray tracing con le reti neurali consente di proiettare un numero ridotto di raggi su pixel mentre la tecnologia neurale si occupa di aggiungere i dettagli mancanti," dice North.

Tutte queste tecnologie sono già a disposizione degli sviluppatori tramite un kit di strumenti per la grafica neurale, che include plugin per

Unreal Engine

. Gli sviluppatori possono integrare il supersampling neurale nei giochi con facilità e accedere ai modelli in formato aperto su GitHub e

Hugging Face

. È anche disponibile la completa emulazione delle estensioni

Arm ML Vulkan

per PC, consentendo l'uso dell'intero stack applicativo senza il bisogno di attendere i nuovi chip mobili.

Se da una parte

Arm

sta aprendo nuovi orizzonti nella fusione tra IA e grafica, non è la prima ad integrare tecnologie neurali nei chip degli smartphone.

Qualcomm

, uno dei principali licenziatari di Arm, ha già ampiamente sfruttato l'IA per migliorare le funzioni delle fotocamere. Durante l'ultimo

Mobile World Congress

,

Qualcomm

ha presentato una vasta rete di modelli linguistici con 7 miliardi di parametri in esecuzione su uno smartphone Android e ha introdotto l'

AI Hub

per sviluppatori, dimostrando l'incredibile progresso delle capacità elaborative delle piattaforme smartphone.